有一种观点认为 人脑是大量神经元组成的神经网络,经过上百万年遗传进化(类似深度学习中的训练),智力也累计量变而质变,终于实现了所谓的智能。

但我觉得如果把神经网络的训练比作人类基因的遗传进化,那神经网络就缺少人类真正学习的过程。 比如,人类学会写代码并不是遗传出来的,而是通过接受自然语言形式的知识习得写代码的功能。 我更倾向把神经网络的训练比作个人的学习过程而不是遗传进化。人类遗传进化类似神经网络的一些超参数,例如层深,层的结构..。

那么对于 ChatGPT ,很明显。它的学习只能是,在代码层接受大量数据来调参。并不能通过它向人类提供的接口而学习。你当然可以对 ChatGPT 告诉它说 "Hi, 从今天起你叫小白,我将用小白来称呼你。",它也会短暂的记住“小白“是它的名字,但它只是在将 "Hi, 从今天起你叫小白,我将用小白来称呼你。"这句话添加到了输入中,根据输入计算输出来回答你。

你不能像教一个姗姗学步的孩子一样,从 1+1=2 一直教到微积分。ChatGPT 没有长期存储模块,当然这只是一方面,其实这也解释了为什么 ChatGPT 只接受 4096 个 Token 。

我想定义一个新名词“智力”,智力是结构的体现,而不是功能的象征,其中结构是功能的元数据,不随功能而改变。智力则决定了功能的上限,也决定了学习的效率。简单来说,人的智力并不会随着学会新知识而提高。对于同一个人,刚出生的婴儿和大学教授的智力是相同的。类比到深度学习,神经网络的智力在网络结构确定时也已确定,调参只增加它的功能而不是智力。所以人类遗传进化增长的是智力,因为大脑结构已经改变了。神经网络的训练增长的是功能。

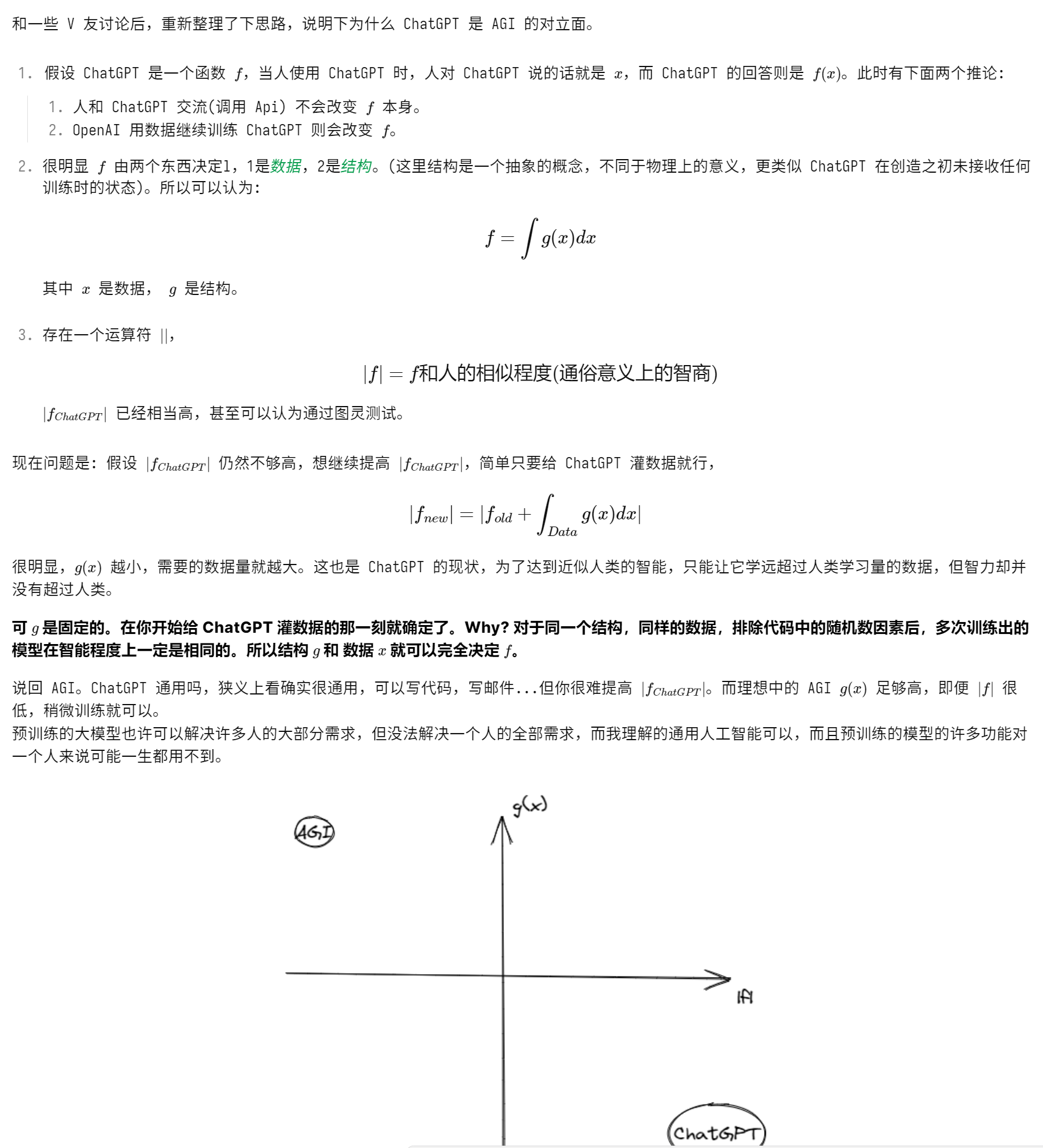

说会通用人工智能。我理想中的通用人工智能首先应该是一个单机的结构,一个人的智力并不依靠互联网。第二通用人工智能要对外暴露学习接口,自然语言形式是最好的,视觉,听觉都可以,甚至神经网络的调参接口也可以。而 ChatGPT 并没有这样的接口。(所以可以本地跑的 LLM 模型是通用人工智能吗?理论上是的,但它的智力十分低下,你教会一个孩子 1+1=2 ,只需要对他用自然语言说出来就可以,但你教会一个从零开始的 LLM ,不知道要用多少数据,训练多长时间。这就是智力决定学习的效率。)

所以一个通用人工智能可以不会写代码,不知道 1+1=2 ,甚至连自己的名字都不知道。但我不介意从零开始指导她(只要她的智力足够高)。而 ChatGPT 正在走一条相反的道路,首先利用海量的计算能力和整个互联网的数据训练一个通晓天地万物的智能机器,但你却没法指导它成为你自己的模样,它属于 OpenAI 却不是你自己。

最后我并不质疑 ChatGPT 的价值,无论商业还是科研方面,ChatGPT 都已经成功证明了自己。我只是觉得世上不应该只有 xxGPT ,通用人工智能的道路满是荆棘,但光辉却洒满大地。希望通用人工智能早日实现。

一个 AI 小白的碎碎念。(前进提要:https://www.v2ex.com/t/893146)

至于其它那些说本文胡说八套但又不指明哪里胡说八道的人,或者上来就给人贴标签的评论,就不回复了。

还有很多想法,懒得写了...

1

jfdnet 2023-04-06 10:18:54 +08:00 你这寥寥数语 既不可能说清楚 chatgpt ,也不可能讲明白所谓人脑(智力)的本质(实际上科学对人脑的认知也非常有限吧)。

“所以一个通用人工智能可以不会写代码,不知道 1+1=2 ,甚至连自己的名字都不知道。但我不介意从零开始指导她(只要她的智力足够高)。而 ChatGPT 正在走一条相反的道路,首先利用海量的计算能力和整个互联网的数据训练一个通晓天地万物的智能机器,但你却没法指导它成为你自己的模样,它属于 OpenAI 却不是你自己。” 这个描述更是谬误,很多年前,AI 训练的方式就已经是让机器去理解 1+1=2 ,而不是记住 1+1=2 。难道你以为 chatgpt 这种,就是把百科全书灌进去而已?那根本不需要所谓的 AI 好么? |

2

swhhaa OP @jfdnet 我哪里提到 chatgpt 是记住 1+1=2 的吗?我的意思是你没法通过 chatgpt 提供的接口教会它 1+1=2 ,只能通过神经网络的训练。

|

3

ymcj001 2023-04-06 10:30:02 +08:00

只结果论就行了,我们并不关心它是如何得出结论的过程

|

4

jfdnet 2023-04-06 10:32:41 +08:00 @swhhaa 你自己做一个 chatgpt 你自己就可以调参训练了。另外 openAI 有一些面向商业的产品,可以给你一定范围的调参训练,就是你理解的“通过 xxx 提供的接口教会它 1+1=2”,你可以买来试试。

|

5

swhhaa OP @jfdnet 是的,但我文中也说了 [所以可以本地跑的 LLM 模型是通用人工智能吗?理论上是的,但它的智力十分低下,你教会一个孩子 1+1=2 ,只需要对他用自然语言说出来就可以,但你教会一个从零开始的 LLM ,不知道要用多少数据,训练多长时间。这就是智力决定学习的效率。]。希望您可以认真读完再发表评论。

|

6

binux 2023-04-06 10:45:30 +08:00

chatgpt 不行,是因为作为一个服务,它存不了那么多用户的 model ,但是只要你出得起,完全可以让 openai 训练一个你自己的 LLM 。

再或者,当 fine-tunning 成熟了之后,也可能会有本地的 LLM 。 |

7

churchmice 2023-04-06 10:49:40 +08:00 欲速则不达,出道即巅峰,这是我的评价

最近又试了一下,在专业领域有 60%的内容在瞎说,忽悠小白倒是不错 |

8

hzcer 2023-04-06 10:50:04 +08:00

应该可以通过类似迁移学习的方式,使得"Hi, 从今天起你叫小白,我将用小白来称呼你。"内化到参数中,但目前受限于存储和算力还达不到吧

|

9

swhhaa OP @binux 是的,但本文重点是 如果存在一种智能,你可以通过自然语言训练她,而不是死板的梯度下降,才算得上理想的人工智能。

|

10

swhhaa OP @churchmice 希望可以指点一下错误的地方,我也想学习学习。

|

13

Ricardoo 2023-04-06 11:04:18 +08:00 显然,博主是人工智能符号主义学派。

在人类能定义出人是如何产生智能,以及智能是什么之前,这些讨论都显得毫无意义。 “而 ChatGPT 正在走一条相反的道路,首先利用海量的计算能力和整个互联网的数据训练一个通晓天地万物的智能机器,但你却没法指导它成为你自己的模样,它属于 OpenAI 却不是你自己。” 人类基因的进化又何尝不是一种利用海量世界数据和上万年时间的预训练呢? |

14

lhbc 2023-04-06 11:06:50 +08:00

高中命题作文水平,基本概念都没搞清楚

|

15

WinG 2023-04-06 11:09:46 +08:00 转一句话:

“有的人天天做测试想证明 ChatGPT 这个不能干那个不能弄,有的人则是一直发掘 ChatGPT 这个也可以那个也可以” by 微博用户 |

16

swhhaa OP |

17

yangyaofei 2023-04-06 11:12:04 +08:00 `一个 AI 小白的碎碎念` 反驳一个东西,至少要先了解那个东西吧

1. '你不能像教一个姗姗学步的孩子一样,从 1+1=2 一直教到微积分` 训练 LLM 模型的阶段不是么? 从这个引申,为何用文本那样训练,如果有足够的(上 T 的)标注文本,你觉得研究人员会不用么. 2. `ChatGPT 没有长期存储模块` 这个说到点子上一点,什么是终身学习,什么是权值遗忘,怎么解决?很多东西不是没有注意到而是现在没有足够好的方法解决 3. `当然这只是一方面,其实这也解释了为什么 ChatGPT 只接受 4096 个 Token 。` 胡说一千零二十四道,赶紧看点实在的东西吧,别让 2 这种确实有用的问题和思考变成鸡屎旁边的蛋糕 4. 什么是通用人工智能, 这本身就是一个问题, 再往本质上说, 难道每个拥有"智能"的人真的拥有"智能"么?还是只是自身几十年所接受信息的镜子? 这一切是注定的化学反应还是真的意志? 少点中二的 BB, 多坐下来看看论文和那种枯燥但是信息熵十足的视频 |

19

sakujo 2023-04-06 11:13:37 +08:00

如果 AI 真的到了你所说的那个阶段,我感觉我真的会害怕了

|

20

zapper 2023-04-06 11:21:00 +08:00

图 YY 迭代了几百次也只有两分钟生命

|

21

swhhaa OP @binux 你说的有道理。但我觉得孩子学到可以理解"1+1=2"的语言输入远小于任何一个神经网络达到相同程度的语言理解力所需的输入,归根结底是因为智力上的本质区别。所以我觉得神经网络结构确定后无论怎么调参,智力都有限,即便 ChatGPT ,通用人工智能应该聚焦在怎么设计结构而不是怎么训练。

|

22

kop1989smurf 2023-04-06 11:26:34 +08:00 名词之争没什么意义。

我也认为机器学习 AI 并不是“AI”,只是统计学上的局部最优解。但我也同样认为纠结“真正的学习”、“智力”等等其实没什么意义。 AI 拟人,其实是一种一厢情愿的意淫。就像人类认为的外星人都是两个眼镜一个鼻子的碳基生物一样。 机器学习 AI 的优势,就是通过强大的并行算力和数据,挖掘人脑没有发现的规律。既然是挖掘,那就一定不会与人的路径完全一样。 所以机器学习 AI ,并不是实现 AI 的唯一道路,我也认为一定不是最佳道路。 只是现在只能这么做,且基于目前的科技、数学水平,这么做最好而已。 btw:机器学习其实是上世纪 80 年代的概念。但基于当时并行算力与统计学的局限,被串行脚本策略 AI 吊打。 |

23

swhhaa OP @yangyaofei 谢谢。我只是论文看腻了,感觉神经网络路走歪了,怎么调都搞不出通用人工智能,发点牢骚。

|

24

iloveoovx 2023-04-06 11:30:11 +08:00

基本逻辑理解全都有问题

甚至最简单的,智力本身。目前广义定义的智力是通过问题回答来测的,根本没有所谓的客观标准。当然,你定义了“结构的体现”,妄想着有一个“客观不变”的“智力”,但是不好意思,即便是神经结构也是在不断改变的,所以不存在教授和儿童智力一致这种事实。所以那些后面推论全都是错的。 |

26

swhhaa OP |

27

pkoukk 2023-04-06 11:38:23 +08:00

+1 名词之争没有意义,它可能不是你心目中的 AGI ,但是已经基本符合当前学术界定义的 AGI 了

|

28

yvescheung 2023-04-06 11:40:05 +08:00

事实上只要你不断和 GPT 聊天,聊天时把所有聊天记录都作为上下文,你也可以把 GPT 调教成你想要的样子。

openai 训练 GPT 模型相当于是模拟人类的进化,而学习相当于是调用 API 。 |

29

raysonlu 2023-04-06 11:46:35 +08:00

我坚持自己的两个观点:

1 )现阶段的手机,对比以前的,已经多了不少的输入(传感器、gps 、联网、摄像头等)和输出,而且还能帮我们在明地或者暗地里“做了不少事”,但我们最多只能说它“智能”,而不是有了“意识”; 2 )人类如果作为造物者也搞不清楚自己的意识怎样产生,不可能做出“能产生意识的产物”。 |

30

swhhaa OP @yvescheung 表示怀疑。首先 ChatGPT 的 token 数量有限制,就算没有限制,给它一部上百万字的小说,你觉得它能搞记住多少里面的内容?除非你用梯度下降去训练它。

|

31

yvescheung 2023-04-06 11:59:54 +08:00

你给一个人类百万字的小说,你觉得他能记住多少里面的内容?或者说你上学时学过的课本,你现在还能记住多少里面的内容?

|

32

swulling 2023-04-06 12:04:01 +08:00 Talk is cheap.

LLM 是不是通向 AGI 的道路不知道,但是其他的路连看都看不见。 与其批判 LLM 走错路了,不如自己走一条正路,如果你用别的方法实现了哪怕 LLM 1/10 的能力,那你肯定会火起来~ |

33

manasheep 2023-04-06 12:08:05 +08:00

你能否认它 通用 吗?

|

34

swhhaa OP @swulling 我没这个能力。只是希望业界认真搞 AGI 的别跟风去研究 ChatGPT ,反正不是我理想中的 AI 。

|

35

akira 2023-04-06 12:10:15 +08:00

人工智能为啥就必须和 人 一样去学东西? 物种都不是一个

|

36

leonshaw 2023-04-06 12:15:29 +08:00

感觉量子效应应该在底层起到关键作用。

|

37

swhhaa OP |

38

IwfWcf 2023-04-06 12:23:47 +08:00

现在的调参和架构设计需要人来参与,但等 AI 水平足够高时就可以让 AI 自己来进行了。就像 AlphaGo 一开始是用人类棋谱来学习,但等 AlphaGo 水平够高后就靠自我对弈来提升了

|

39

swhhaa OP @manasheep 狭义上的通用就是 ChatGPT 这样,一个预先训练好的大模型,啥都懂,啥都会,但不能通过它提供的能力自然而然的学习。广义上的通用是这样的,她开始啥都不会,甚至 1+1=2 都不会算。但你可以教她,先从学会说话开始,学会说话后,教她 1+1=2 ,教她使用互联网,然后对她说,你已经是一个成熟的 AI 了,今天我想写一段 xx 功能的 python 代码,但我不会。你自己去互联网上学学怎么写代码,然后给我写一下这个功能。

|

40

IwfWcf 2023-04-06 12:25:43 +08:00 至于单体效率是没有意义的,因为从一个分布式系统的角度考虑,人组成的集群可扩展性是很有限的,但机器效率再低可扩展性也完爆人类

|

41

me221 2023-04-06 12:29:02 +08:00

「 ChatGPT 没有长期存储模块」

============= 可以存硬盘里. |

42

raymanr 2023-04-06 12:29:06 +08:00

我觉得这个已经超出了我的知识边界, 但确实也能明显感受到 Chatgpt 存在不同于以往 AI 的推理能力.

但是从历史角度来看, 也有不少东西是先应用了, 然后再慢慢被发现运行原理的, 或许 LLM 的能力再往上提升需要指数级别的投入增加; 或许通过 LLM 了解到了某些原理, 以后人类通过类似训练 LLM 的方式来学习? 谁知道呢. 而且如果把输入数据不局限于文本, 而扩展到视觉信息, 频率信息的输入(反正都是数据), 是否有可能在其他领域出比肩 chatgpt 能力的 AI ? 这些领域也是有待开发的. |

43

yvescheung 2023-04-06 12:30:26 +08:00 via iPhone

@swhhaa 你不如问一问为什么地球生命花了几十亿年的进化才出现人类的智力,为什么人类的大脑不能像孙悟空一样从石头缝里蹦出来

|

44

binux 2023-04-06 12:32:32 +08:00

|

45

swulling 2023-04-06 12:32:33 +08:00 via iPhone @swhhaa 那你可能对科研有什么误解。

现实中研究 AGI ,并不是什么人说我要研究 AGI ,然后一步一步一步的就研究出来了。 而是各个实验室在很多领域年拱一卒,然后某个方向比如 LLM 恰好效果比较好,那就用一波。 至于是不是正确的路,我觉得目前没有人有资格说。只能说这个分支树是最靠近的,但是也可能是死路。 现在依然有很多实验室在拱别的领域。 |

47

makelove 2023-04-06 12:43:41 +08:00

@swhhaa 真做到这个通用程度可以说强 ai 了,秒杀真人,实现财务自由只要给 ai 一句话:“不管用什么办法,给爷网赚一个小目标”。这种 ai 至少要能无限推理步骤,目前的 ai 方式完全不行。

|

48

yangyaofei 2023-04-06 12:44:41 +08:00 @swhhaa 从你的发言没感受到真的读过论文

|

49

swhhaa OP @swulling 如你所说,当前阶段 LLM 的效果的确是最好的,所以希望其他方向的实验室不要去跟风。 我的观点是 ChatGPT 不是正确的道路,不管是不是,我都想尽快体验到我理想中的 AGI ,宁愿我的观点是错的。

|

50

javlib 2023-04-06 13:06:25 +08:00

没有发明飞机前,人类对飞行的想象就是鸟人,人有翅膀和羽毛,跟鸟一样飞行。飞机出现后,人类对飞行的定义就多了一种,不用翅膀扇动的飞机也能飞行。

现在讨论“智能”,因为人类只见过人这种智能,所以只能想象像人一样的智能。其实不能排除有其他形式的智能,如果一个 AI 能完成人的工作,在 90%的任务上比 90%的人类做的好,我觉得就足以称为智能了。 再举个例子,同一道高中数学证明题,有的学生要按照老师教的套路,一步一步做证明,有的聪明学生可以一眼就构思出整个证明过程,并且更加简单优雅,这个普通学生看聪明学生的证明就觉得太神奇了,为什么不用一步一步做。现在 llm 就不像人类儿童的学习过程,但是 chatgpt 的输出在很多方面跟人的输出差不多,类比于飞行,我觉得可以把 llm 当作飞机,人就是自然演化的”鸟“,llm (飞机)和人(鸟)都可以(产生和输出智能)飞行 |

51

18601294989 2023-04-06 13:09:07 +08:00 ChatGP 当然能学习,只不过是你没有让他学习的权限罢了。 openAI 当然不能把这个权限给你,你会把自己的孩子送到一个陌生人的手里学习知识吗,你知道这个陌生人教的知识是对的还是错的啊、

|

52

swhhaa OP @yangyaofei 我确实没有看过 Transformer 的论文,但 Transformer 不基于神经网络吗。如果路走错了,走的再远也是错的。关于 17 楼你的几个点

1. 我说的教是指把这些知识以自然语言的形式告诉 ChatGPT 。你如果指训练,它当然可以从 1+1=2 学到微积分,但有什么用,没学过代码的人能从零训练一个懂微积分的神经网络吗。但学过微积分的人却可以教会其他人微积分。 2. 如你所说,神经网络目前并没有好的解决方案。 3. ChatGPT Token 的限制当然并不直接受限于长期存储模块,但最初的神经网络本就不是为了实现通用人工智能而设计的。 4. 我给出了我理想中通用人工智能的定义,你当然可以说它是错的。 |

53

TMM 2023-04-06 13:25:59 +08:00

纠结名字没啥意义, 现在国内有实力的大组基本都 ALL IN 大模型了

|

54

FreshOldMan 2023-04-06 13:28:45 +08:00

|

55

TMM 2023-04-06 13:48:03 +08:00 首先人的智力在是婴儿和大学教授的时候是不一样的

其次隔行如隔山, transformer 都没看过建议不要上来就说 LLM 路线错了这种暴论 |

56

csimplestring 2023-04-06 14:21:49 +08:00 碳基智我们自己都还没搞清楚,凭什么要求硅基智能跟我们一样?

|

57

yangyaofei 2023-04-06 14:25:01 +08:00

@swhhaa

1. "教" 和 "训练" 的本质区别是什么? 为什么两者不同?为什么不能通过二实现一? LLM 训练的过程不是自然语言形式? 怎么定义 "模型没有学会微积分" 进而推广, 如何证明人类真的学会微积分? 利用一个例子去学会一类东西, 这个都到不了 LLM 这个阶段, 在 meta learning 的领域就已经被定义了. 最后最基本的,如何自大的认为 AGI 一定要通过自然语言才能"学成"一个 AGI?作为一个人类,也过于自大了吧? 2. 神经网络没有"好"的解决方案, 但是有的是还行的方案,以及 GPT 的解决方案 3. 关于 token 限制的认识, 明显说明你什么都没读过, 类似于:虽然我不怎么了解牛顿三大定律和黎曼积分更不知道参考系变换原理等等等等,但是我看了"一分钟看懂相对论"之后,觉得相对论是错误的,我觉得以后的相对论应该是 XXXXX 无知 自大 中二 |

58

swhhaa OP @yangyaofei

1. 教和训练的区别就是伪人工智能和通用人工智能的本质区别。举例来说,如果有些知识是没有被 ChatGPT 训练的,你想让 ChatGPT 学到这些知识,只能通过训练的方式,但不会写代码的人是做不到的。对于通用人工智能,不会写代码的人却可以通过许多方式,自然语言也好,其他方式也好,如此的通用人工智能人人都有却又人人不同,并且自我迭代。 2. 也许吧。但 ChatGPT 并没有达到我的预期。 3. 如果你懂的话希望你解释下,如果你想反驳一个人请举出错误的观点并加以论证,而不是给人贴标签。如果你继续贴标签的话,希望不要回复了。 |

59

summerLast 2023-04-06 15:43:53 +08:00 我的观点是它不是对立面,只是其中的一个分支的具体实现,为什么是 chat 不是 roboot ,这是因为图片和文字生成是目前相对最快能出成绩的领域 ,他需要给金主一些正向反馈,从而获取更多的支持,而 chat gpt 目前只是一个基于 gpt 的 chat 界面,未来随着插件的发布和 memory 的加入你可以拥有自己 env 的 gpt, chat 是界面 ,gpt 才是关键,一切才刚开始,我对他往通用人工智能的靠近保持乐观的态度

|

60

Chihaya0824 2023-04-06 15:52:49 +08:00

那么他自己是怎么想的呢?

Chat gpt 自己觉得你在以下几点说的有点不准确: 1. The author believes that ChatGPT cannot learn from its interactions, i.e., it cannot acquire new knowledge in the way humans do through natural language. While it is true that ChatGPT cannot learn in real-time as humans do, it does learn from the vast amount of data it has been trained on, which includes natural language texts. It is important to note that GPT models, including ChatGPT, are pretrained on a large dataset and can be fine-tuned for specific tasks or domains. However, they do not have the ability to learn incrementally during an ongoing conversation. 2. The author argues that an ideal general AI should have a learning interface that accepts natural language input. While ChatGPT doesn't have this interface directly, it can still be fine-tuned on specific data or tasks, which could include examples of natural language input. 3. The author implies that an ideal general AI should have the intelligence to learn from scratch without prior knowledge or training, whereas ChatGPT is pretrained on a large amount of data from the internet. However, AI models like ChatGPT benefit from this pretraining because it allows them to have a broad understanding of various topics and helps them generate coherent and contextually relevant responses. 同时,肯定了你的这些观点: 1. ChatGPT's limitations: The author recognizes that ChatGPT has limitations, and it's essential to be aware of these when using the model. Some of the limitations include the inability to learn in real-time during conversations, providing incorrect or nonsensical answers, sensitivity to input phrasing, and a tendency to be verbose. 2. The need for a better AI: The author's pursuit of an ideal general AI suggests that they understand the importance of improving AI systems to overcome the limitations of current models like ChatGPT. The quest for a better AI is a crucial aspect of ongoing research in the field of artificial intelligence. 3. Importance of natural language learning: The author emphasizes the significance of AI systems being able to learn from natural language input. This is a valuable insight, as understanding and processing human language is a critical aspect of making AI more useful and accessible to a broader range of people and applications. 我个人觉得 chatgpt 的 token 限制和长期存储模块大概率是无关的 “GPT-4 now has 8k tokens max, and there is a larger 32k token model on the horizon in the API.” [here]( https://community.openai.com/t/gpt-4-api-what-is-the-chat-history-limit-and-token-completion-limit/103094/2) 现在目前 GPT4 已经就提供了>4096 个 token 的支持,以后也会变的更大。 |

61

probe301 2023-04-06 15:54:58 +08:00 其实, 能理解楼主是在真诚的思考和讨论,

但确实提到事实错误太多了, 看着不舒服, 具体错误不想挨个说 > 我想定义一个新名词 “智力” 定义 “智力” 这太糟了, 宁可用一个冗长但无歧义的词, 比如 "决定生物 /硅基物的学习潜力限制的物理基础" (这词也不精确) 这坨问题已经很复杂了, 别再引入似是而非的词语了 楼主其实不太在意具体工程细节, 他就想跟大伙讨论 ChatGPT 这条思路, 对于实现通用智能的目标, 是不是走歪了 这其实有许多人都批判过了, 有篇 http://www.incompleteideas.net/IncIdeas/BitterLesson.html 全文说的是: 人类的概念, 可能只是人类蹩脚的认知工具 / 脚手架, 别把人类 "为了认识世界而生造的概念" 灌输给机器, 应该让它自己学, 让 AI 能够像我们一样发现, 而不是教给 AI 我们已发现的 楼主可以看看 |

62

zhengkk 2023-04-06 16:01:32 +08:00

@churchmice #7 出道即巅峰可以理解,欲速则不达什么鬼?这不是在一步步的优化么,只能说是进展飞快。如果您所指的专业领域是关于中文内容的话,确实可以说是忽悠小白,这是天朝的大环境所致,或许您可以试试用纯英文沟通交流,据说美国大学生都用它来写论文。

|

63

superJava 2023-04-06 16:11:13 +08:00

我感觉你在巨人肩膀上拉了泡屎,每一段都有槽点,无力反驳了

|

64

0o0o0o0 2023-04-06 16:21:19 +08:00

1.没学过代码的人不能训练神经网络,因为 chatgpt 并没有完整实现人的全部功能,但是不代表他不能模拟部分功能,也不能说明他是人工智能的对立面。

2.神经网络本身就包含了记忆,比如人脑的海马体就是短期记忆,而 chatgpt 的记忆目前只能用 token ,但是这只是说明了他没有记忆网络,还是不能说明他是人工智能的对立面。 联系 1 和 2 ,其实你和他对话本身就是在训练他,只不过这个 token 并不是存储在这个神经网络中,并且每次刷新都会复原而已。 3.的确神经网络本身基本上决定了智力(不过儿童和成人智力水平还是有区别的,人脑在幼儿时期神经元之间的连接是快速变化的,大了就固定下来了,很难再改变),而 gpt 很显然规模相比于人脑还是太小了,所以智力肯定无法和人比。 |

65

swhhaa OP @Chihaya0824 我不知道你是怎么向 ChatGPT 提问的。但是其中不准确的几个点感觉没说到点子上啊。

1. ChatGPT 的训练材料包含自然语言,但这些不能直接喂给 ChatGPT ,许多向量化等操作后早就不是自然语言了。 2. 我文中并没指明通用人工智能一定要通过自然语言接口学习。而且 ChatGPT 通过 fine-tune 来实现各种任务和我的观点并不冲突。 你可以把我这些话再发给它看看能不能理解... @0o0o0o0 其实我这里的对立面是指:其他方向的研究人员看到 ChatGPT 目前如此成功,跟风去搞 ChatGPT 。很有可能像多年前符号主义打败连接主义一样,走了很多年弯路后发现符号主义是错的。ChatGPT 也有可能带偏整个业界,导致 AGI 出现晚许多年。至少在我看来。 |

66

ErrorMan 2023-04-06 16:37:32 +08:00

感觉楼主需要先区分哪些是 OpenAI 做的安全措施,哪些是 ChatGPT 的本身限制。

关于记忆的问题,ChatGPT 并不需要作为一个完整的存在,它完全可以接入更多的设施来补全相关的方面,比如外置存储设备来保存记忆,其实现在聊天输入的上下文也是一种短暂的记忆。 另外谈到论文,论文研究里已经有人在尝试把 ChatGPT 组合到各种已有的 AI 里,这个过程只要提供接口 ChatGPT 就能学习如何使用,它可以成为那个万能的粘合剂。 总结下来还是那句话,ChatGPT 不需要作为完整的 AGI 存在,它只要成为拼图其中重要的一块碎片就够了。 |

67

0o0o0o0 2023-04-06 16:51:23 +08:00

@swhhaa

1.人脑也不是直接把声音直接啪地放到脑子里了,首先要经过各种传导,到耳蜗之后通过听觉毛细胞对声音的不同频段进行分离并且转化为电信号,再通过神经传递到脑部,而这之间本身就和特征提取很相似。其他的视觉什么的也是一样的。所以说可以说向量化本身就可以作为这个网络的一部分。 2.ChatGPT 也有可能带偏整个业界,导致 AGI 出现晚许多年,但是也可能是正确的,但是人无法预知自己不可能预知的事情,“ChatGPT 也有可能带偏整个业界”本身只有在未来才能被证明。 |

68

swhhaa OP @0o0o0o0 你说的第一点启发了我,声音各种转化的过程属于 AI 的功能,所以为啥不给 ChatGPT 添加一个把自然语言向量化的模块让它可以直接通过自然语言学习呢?

|

69

0o0o0o0 2023-04-06 16:59:15 +08:00

@swhhaa 你是觉得科研资源分配不能够过于偏向 gpt ,但是这不是 gpt 的问题,即使没有 gpt 有其他 abc 、cde ,能实现好的效果,资源仍然会倾向他们。所以按照这种逻辑“gpt 是人工智能对立面”应该改成“人类的趋利是人工智能的对立面”。但是到底 gpt 是不是人工智能的未来,本身就不可能知道,但是至少他现在的效果最好。

|

70

TMM 2023-04-06 17:05:09 +08:00

虽然知道我连高等数学统计推断可能都学不明白, 但是我觉得我能聊一聊 AGI 的路线是不是对的

Confidence is all you need |

71

jhdxr 2023-04-06 17:09:17 +08:00

这个 AI 小白是民科也算科学家的另外一种表达吗?

1. 现在的神经网络虽说借鉴了人脑,但的确绝对不一样(目前没有任何生物学上的研究能证明类似 BP 这样的机制的存在)。 2. 我之前也不认为现有的方式能够做到真正的 AGI ,但现在看来这很有可能是通向足够好的 AGI 的方式。 === 帖子里剩下的内容就**全**是槽点了。不重复其他人的发言顺着当前的讨论反驳几点: @swhhaa #65 1. 『许多向量化等操作后早就不是自然语言了。』一个只会中文的人面对一个只会英语的人能不能认为对方完全没有语言能力?吱哇乱叫不知所云。 2. 你一直在强调的模型没有记忆功能,那模型的参数是啥?没有记忆功能只是因为在做 predict 的时候不会去更新参数。如果现在有一种神奇的力量锁定了你大脑的突触之间的连接(并且这种神奇的力量也可以随时解除 /再锁定),你觉得你有记忆功能吗? |

72

0o0o0o0 2023-04-06 17:14:11 +08:00

@swhhaa 向量化本身就是它的一部分啊,如果你说的是为什么我不能直接给“它”一个 txt 文件就好了,就好比有的程序是图形界面的,有的程序只有命令界面没有图形界面,因为面向的用户不同,而训练这个场景面向的基本上都是开发者,其次 gpt 本身并没有智能到那个程度,就像如果一个人只有大脑的部分,想要“教”他,需要人为搭建环境、处理各种信息生成电信号刺激这个大脑,况且 gpt 甚至只相当于大脑的一个区块。

|

73

SunnyCoffee 2023-04-06 17:18:06 +08:00

你低估了一个孩子理解“1+1=2”需要的训练成本。孩子出生开始就通过视觉、触觉、味觉、嗅觉、听觉多维度的接受信息输入,同时思考还会从已有的信息中派生出更多的信息,这一过程持续几年产生的输入信息是海量的。

|

74

swhhaa OP @jhdxr

1. 不知道你想反驳啥... 人类可以通过自然语言形式的知识学习,神经网络只能通过向量形式的知识学习。如果普通人可以把知识天然得向量化并传授给 ChatGPT ,那我就认为它是 AGI 。 2. 你觉得你调一次 ChatGPT 的 API 告诉它一些知识,它的参数会变化?神经网络学到的是参数,但你跟 ChatGPT 说话并不能更新参数,所以你觉得调用 ChatGPT 的 API 就可以让 ChatGPT 学习吗?那么学的是啥?既然啥都没有学到那他把你告诉它的知识存在了哪里? |

75

Ericcccccccc 2023-04-06 17:21:08 +08:00

你感觉自己是怎么学会 1+1=2 的?

|

77

ALLROBOT 2023-04-06 17:24:22 +08:00

搞笑,科学家都没弄明白离散数学,更别说体现离散数学的神经网络

等搞明白了再争论人工智能的定义 |

78

thinker007 2023-04-06 17:37:11 +08:00

人类要飞行 无需弄懂鸟类如何飞行,事实上 弄懂鸟类飞行就是一条错误的道路,正如历史上的扑翼机没一个成功的。

同样,要模拟人脑,本身就无需全部模拟人脑的结构,能端到端的实现学习的效果就好。 |

79

plmsuper8 2023-04-06 17:41:02 +08:00 GPT4:这篇帖子讨论了 ChatGPT 和通用人工智能之间的关系。作者认为,虽然神经网络的训练过程类似于人类基因的遗传进化,但神经网络缺少了与人类学习相对应的过程。ChatGPT 只能通过大量数据调整参数,而无法通过与人类交互的方式学习。作者还提出了一个新的名词“智力”,指的是结构的体现而非功能象征,智力会决定一个模型学习的上限和效率。 这篇帖子引发了不少讨论,有些人认为 ChatGPT 已经基本符合现有通用人工智能的定义,而有些人则认为 ChatGPT 不是他们心目中的通用人工智能。但我们需要理解不同观点和看法,并保持开放的心态。尽管 ChatGPT 有一些局限性,但这并不意味着它对科研和商业应用没有价值。通用人工智能的道路仍然充满挑战,我们需要不断尝试新的方法和思路来追求更理想的智能。

|

80

plmsuper8 2023-04-06 17:44:48 +08:00

BTW ,现在有用插件扩展 LLM 知识的方法。就是先搜索本地向量化知识库,再用 LLM 组织语言

|

81

billzbc 2023-04-06 17:53:08 +08:00

分享一个上周直播课的文档,通俗的介绍了一些 AGI 的原理:

https://drive.google.com/file/d/1nlTyxUCD9EZf6t-FEXC4GP6qC64BqkMZ/view?usp=sharing |

82

ijava 2023-04-06 17:54:29 +08:00

感觉 100 年以后应该是能有意识的

|

83

swim2sun 2023-04-06 18:07:51 +08:00 via iPhone

人类飞上天并不是靠模仿鸟,而是通过空气动力学,同样实现“智能”不一定要人机器像让一样思考

|

84

aliveyang 2023-04-06 19:04:19 +08:00 via Android

可以本地跑啊,只不过这个本地的成本很高

|

85

yzqtdu 2023-04-06 22:30:24 +08:00

未来的研究发现可能会颠覆我们当前的认知甚至超出我们当前的想象能力,今天的”我认为”判断都可能太武断。另外,情景学习其实可以看作模型在隐式地进行微调,参见 Why Can GPT Learn In-Context?

Language Models Secretly Perform Gradient Descent as Meta-Optimizers https://arxiv.org/pdf/2212.10559.pdf |

86

jspatrick 2023-04-06 23:13:20 +08:00

我感觉缺少的那个灵动的点是主观能动性,是自我思考与学习,而不是被动输入,现在就有点像膝跳反射一样,说到底缺少了那么点真正的灵魂

|

87

neoblackcap 2023-04-07 00:41:52 +08:00

@Ricardoo 人类的基因组数据就 6.2GB 左右,ChatGPT 的模型怕不是比这个大多了。但是从各种深一点的推论来看,它远没有达到人类的智能。只能说底层的数学模型没法很好地描述“智能”。

与其将 ChatGPT 称之为人工智能,我更加倾向于这是人类未了解空气动力学之前仿照鸟类做的飞行器。 |

88

WuSiYu 2023-04-07 01:13:03 +08:00 via iPhone

有没有一种可能,chatgpt ( instructgpt )的关键技术之一就是 RLHF ( Reinforcement Learning from Human Feedback )

有没有一种可能,一个很重要的研究点就是 fewshot 、oneshot 乃至 zeroshot 的表现 与其发表“形而上学”的观点,不如先去了解一下现实吧 |

89

aliezoip 2023-04-07 01:52:22 +08:00 via iPhone

chatgpt 是按照一个工具在做

|

90

Chihaya0824 2023-04-07 02:14:54 +08:00

@swhhaa 啊,我是就把整个帖子前 20 楼丢进去提问他整理下准确和不准确的地方

It is true that the training material for ChatGPT contains natural language, and before being processed by the model, it undergoes various preprocessing steps, such as tokenization and vectorization. However, the model still learns to process and generate human-like text based on the patterns and structure of natural language present in the training data. I apologize for any misinterpretation of the author's point of view. It's important to note that while ChatGPT is a powerful language model, it is not an example of a general artificial intelligence. The process of fine-tuning the model for specific tasks indeed does not conflict with the author's perspective. There are various ways AI can learn and interact with the environment, and natural language is just one of those methods. 上面是他的回复 |

91

icoming 2023-04-07 02:57:26 +08:00

只会直线想事情,稍微复杂一点的事情,问答是绕来绕去的,能把人气死

|

92

009694 2023-04-07 08:31:07 +08:00 via iPhone

虽然 op 很认真的在讨论,但是看得出来 语文能力堪忧、逻辑能力堪忧、哲学思考堪忧,然后还带了些中二

|

93

swhhaa OP @thinker007

@swim2sun 是的。所以我也并没有讨论大脑是如何工作的。我认为 AGI 至少应该行为表现的像大脑,大脑可以通过接收自然语言,视频,音频..学习,而且效率远大于目前的 ChatGPT 。 |

94

obama 2023-04-07 10:05:59 +08:00

ChatGPT 本质上是一个模拟结构,训练也是不断通过不断喂数据不断优化,是“连续可微的”,这与非零即一的传统计算机在实现方式上有本质的不同,而传统计算机则是“离散的”,程序的演化只能通过修改排错来实现。而一些数学机械化任务则非对即错,是离散的,当前更适合传统结构的计算机来完成,而生成类任务是连续的,ChatGPT 当然更擅长。至于如何打通连续和离散的根本,百年之前康托尔就提出过“连续统假设”这个论题了

|

95

silypie 2023-04-07 10:10:27 +08:00

你可以了解一下 LeCun 的“世界模型” https://www.infoq.cn/article/87rqw0eatxh0u0agdt0w

|

96

Ricardoo 2023-04-07 11:10:36 +08:00

@neoblackcap chatgpt 是稠密模型,有相当大部分参数可以蒸馏剪枝,也许理解了模型黑盒后可以压缩到非常小。最后的比喻非常形象,有一种“人类妄想通过科技蛮力比肩神明”的原始力量 ^_^

|

97

sillydaddy 2023-04-07 11:49:38 +08:00

@silypie #95

「正如 Meta AI 首席人工智能科学家 Yann LeCun 所指出的那样,一个从未摸过方向盘的青少年可以在大约 20 个小时内学会开车,而当今最好的自动驾驶系统也需要数百万甚至数十亿带标签的训练数据和数百万次虚拟环境中的强化学习试验。即便如此,它们驾驶汽车也还是不如人类可靠。」 感觉 LeCun 拿这个举例子,比外行还要外行。 这不就是预训练大模型在做的事情吗:大模型预训练的基础能力就是对这个世界的常识认知(比如物体识别、障碍物、动机预测),开车仅仅需要微调训练即可? 就好比现在训练 ChatGPT 在每个句子中的每个字之间插入一个新的字,或者让 ChatGPT 统计段落的字数。唯一的区别是现在 ChatGPT 的预训练,只是通过自然语言和代码的语料来完成的(还有图像)。 |

98

sillydaddy 2023-04-07 11:54:42 +08:00

@silypie

我忘了是在哪里看到过了,llya 说 LeCun 说的,跟 OpenAI 在做的,其实没有什么大的区别。我理解的就是,大模型训练得到的能力,肯定是跟训练的输入有关的啊,你拿互联网的语料训练它,它肯定得不出世界运行的逻辑啊,但如果把现实世界的输入和反馈给到它一起训练呢? |

99

lambdaq 2023-04-07 11:57:40 +08:00

> 你不能像教一个姗姗学步的孩子一样,从 1+1=2 一直教到微积分。ChatGPT 没有长期存储模块,当然这只是一方面,其实这也解释了为什么 ChatGPT 只接受 4096 个 Token 。

实际上人也没有长期存储模块。不信的话你和 chatgpt 一起比赛做一个四位数乘除法。都不允许用草稿纸。你看你算得对还是 chatgpt 算得对。 人很多自以为 nb 的记忆、推理能力实际上是需要借助外部工具才能实现的。 |

100

dongzhuo777 2023-04-07 12:15:25 +08:00

先说明我没有去研究过 AI 相关的学术论文,但就目前我对 chatgpt 的使用情况下来。我觉得它还不具有逻辑思维的能力。最多就是个万能百科全书,过滤掉广告垃圾,高级一点的谷歌、百度而已。我认为真正的智能是有自己的逻辑思维,哪怕这个思维逻辑是错误的。但目前来看现在的 AI 并没有。毕竟它不会思考

|