beginor's repos on GitHub

JavaScript · 910 watchers

clean-code-javascript

:bathtub: Clean Code concepts adapted for JavaScript

TypeScript · 175 watchers

clean-code-typescript

Clean Code concepts adapted for TypeScript

C# · 162 watchers

DesignPatterns

C# Design Patterns

Dockerfile · 66 watchers

docker-gitlab-ce

GitLab CE zh-cn docker file

C# · 22 watchers

iBATIS_2010

iBATIS.Net 1.6.2 update to .net 4.0

Shell · 14 watchers

docker-jexus-x64

Jexus x64 Standalone for Linux docker image

Shell · 13 watchers

docker-datax

Alibaba DataX in docker

Dockerfile · 11 watchers

docker-aria2

aria2 and httpd (busybox) in docker

C# · 10 watchers

html-app-demo

html app with angular + webapi under mono

TypeScript · 9 watchers

cesium-typings

Typescript definition for cesium

Dockerfile · 8 watchers

docker-kms-server

a docker image for kms

C# · 7 watchers

beginor.owin

My effort trying integrate castle windsor with microsoft owin.

C# · 5 watchers

aspnetcore.authentication.token

Token authentication for asp.net core.

JavaScript · 5 watchers

beginor.github.io

TypeScript · 5 watchers

esri-service

Common used helper method for arcgis js api based on esri-loader

C# · 4 watchers

BaiduMapBinding

Shell · 3 watchers

docker-jexus

Jexus web server in docker

C# · 2 watchers

aspnetcore.middlewares

Some useful middleware for aspnetcore.

C# · 2 watchers

Beginor.Owin.Security.Aes

Aes provider for Microsoft.Owin.Security .

C# · 2 watchers

Beginor.Owin.StaticFile

OWIN simple static file middleware

Shell · 2 watchers

docker-agdatastore

ArcGIS Datastore in docker

Shell · 2 watchers

docker-agportal

ArcGIS Portal on Docker

Shell · 2 watchers

docker-ubuntu-china

Ubuntu 16.04 LTS base image with china apt mirror.

JavaScript · 2 watchers

dx-locale-zh-cn

Chinese localization messages for DevExpress/DevExtreme

1 watchers

2048

A small clone of 1024 (https://play.google.com/store/apps/details?id=com.veewo.a1024)

C# · 1 watchers

AChartEngineBinding

AChartEngine Xamarin.Android binding project

JavaScript · 1 watchers

AdminLTE

AdminLTE - Free Premium Admin control Panel Theme That Is Based On Bootstrap 3.x

1 watchers

anemll

Artificial Neural Engine Machine Learning Library

TypeScript · 1 watchers

angularjs-arcgis

TypeScript · 1 watchers

angularjs-openlayers

C# · 1 watchers

asp-net-identity

C# · 1 watchers

aspnet_Home

JavaScript · 1 watchers

AssemblyNavigation

A navigation framework for Silverlight, witch can load your silverlight assembly on demand.

Shell · 1 watchers

docker-agserver

ArcGIS Server on Docker

Shell · 1 watchers

docker-geoserver

GeoServer in docker

Shell · 1 watchers

docker-mono

Xamarin docker image based on Ubuntu 16.04

Shell · 1 watchers

docker-postgis

PostGIS with ESRI add ons.

Shell · 1 watchers

docker-xfce-vnc

XFCE and VNC based on Ubuntu in docker

Python · 1 watchers

f5-tts

Official code for "F5-TTS: A Fairytaler that Fakes Fluent and Faithful Speech with Flow Matching"

Python · 1 watchers

f5-tts-openai

OpenAI compliant speech api with SWivid/F5-TTS

JavaScript · 1 watchers

jsmind

Javascript version of mind mapping

C# · 0 watchers

agent-framework-demos

Microsoft agent framework demos with C#

0 watchers

awesome-prompts

收集的一些提示词

0 watchers

beginor

My custom profile

C# · 0 watchers

beginor-owin-security-gdep

JavaScript · 0 watchers

bootswatch

Themes for Bootstrap

0 watchers

chat-tts

ChatTTS is a generative speech model for daily dialogue.

0 watchers

chatgpt-vercel

Elegant and Powerfull. Powered by OpenAI and Vercel.

Python · 0 watchers

claw-code

Better Harness Tools, not merely storing the archive of leaked Claude Code but also make shit things done. Featured in Wall Street Journal

0 watchers

cocopilot

一个小工具的备份

0 watchers

codecombat

Game for learning how to code.

C# · 0 watchers

CoGeoTiff

Open Cloud Optimized GeoTiffs in C# Console Library

0 watchers

comfyui_sonic

Sonic is a method about ' Shifting Focus to Global Audio Perception in Portrait Animation',you can use it in comfyUI

TypeScript · 0 watchers

cordova-zhihu-daily

C# · 0 watchers

Core

Castle Core, including Castle DynamicProxy, Logging Services and DictionaryAdapter

Python · 0 watchers

cosyvoice

Multi-lingual large voice generation model, providing inference, training and deployment full-stack ability.

0 watchers

cubism-ts

Typescript ES6 module of cubism.js, based on d3v5.

JavaScript · 0 watchers

d3-timeline

D3 timeline

TypeScript · 0 watchers

deck.gl

WebGL2 powered geospatial visualization layers

TypeScript · 0 watchers

definitely-typed

The repository for high quality TypeScript type definitions.

0 watchers

delineator

Fast, accurate watershed delineation using hybrid vector- and raster-based methods and data from MERIT-Hydro

JavaScript · 0 watchers

DevExtreme

HTML5 JavaScript Component Suite for Responsive Web Development

TypeScript · 0 watchers

dify

Dify is an open-source LLM app development platform. Dify's intuitive interface combines AI workflow, RAG pipeline, agent capabilities, model management, observability features and more, letting you quickly go from prototype to production.

Dockerfile · 0 watchers

docker-fastapi

Python FastAPI in docker.

Dockerfile · 0 watchers

docker-gh-pages

github-pages in docker

Shell · 0 watchers

docker-headless-vnc-container

Collection of Docker images with headless VNC environments

Shell · 0 watchers

docker-jetbrains

Shell · 0 watchers

docker-mono-runtime

Shell · 0 watchers

docker-node

Shell · 0 watchers

docker-openjdk

OpenJDK 8 for docker

Shell · 0 watchers

docker-openjdk-jre

openjdk jre

Shell · 0 watchers

docker-osgeo

osgeo tools in docker

Dockerfile · 0 watchers

docker-rasterio

docker rasterio

Dockerfile · 0 watchers

docker-shadowsocks

shadow socks

Dockerfile · 0 watchers

docker-tinyproxy

tinyproxy based on alpine:latest

0 watchers

downkyicore

哔哩下载姬(跨平台版)downkyi,哔哩哔哩网站视频下载工具,支持批量下载,支持8K、HDR、杜比视界,提供工具箱(音视频提取、去水印等)。

0 watchers

ds2api

DeepSeek-Compatible Middleware Interface: A technical exploration project in Go, focusing on high-concurrency protocol adaptation. It serves as a reference implementation for converting diverse web protocols into standardized formats.

0 watchers

dust3r

JavaScript · 0 watchers

esri-jsapi-resources

A collection of useful resources for developers using the ArcGIS API for JavaScript.

TypeScript · 0 watchers

esri-loader

A tiny library to help load ArcGIS API for JavaScript modules in non-Dojo applications

TypeScript · 0 watchers

esri-ts-demo

ESRI ArcGIS JavaScript API with TypeScript Demo

Python · 0 watchers

f5-tts-mlx

Implementation of F5-TTS in MLX

0 watchers

facetype.js

typeface.js generator

Java · 0 watchers

geoserver

Official GeoServer repository

Scheme · 0 watchers

geoserver-data_dir

default data_dir of geoserver

0 watchers

googauth

The Python Command-line Reimplementaion of Google Authenticator

0 watchers

gpustack

Manage GPU clusters for running AI models

Python · 0 watchers

graphrag

A modular graph-based Retrieval-Augmented Generation (RAG) system

C# · 0 watchers

hilo-sample

Hilo Id Generator sample for both NHibernate and EntityFramework Core.

0 watchers

http-api-design

HTTP API design guide extracted from work on the Heroku Platform API

HTML · 0 watchers

http-api-design-ZH_CN

HTTP API 设计指南(http-api-design-ZH_CN),翻译自https://github.com/interagent/http-api-design

JavaScript · 0 watchers

impress-demo

impress.js demo

JavaScript · 0 watchers

impress.js

It's a presentation framework based on the power of CSS3 transforms and transitions in modern browsers and inspired by the idea behind prezi.com.

Vue · 0 watchers

insights

Open Source Business Intelligence Tool

Java · 0 watchers

interop-test

TypeScript · 0 watchers

ionic-demo

Track demos/tests of ionic 4

TypeScript · 0 watchers

ionic2-seed

ionic2 seed application with systemjs

0 watchers

jexus

jexus web server

C# · 0 watchers

jexus-ms-owin-demo

MS OWIN Demo with jexus.

C# · 0 watchers

jynew

金庸群侠传3D重制版

beginorV2EX member #56321, joined on 2014-02-19 21:29:19 +08:00Today's activity rank 17592 |

| Augment Code 计划在 2026 年 3 月 31 日关闭 IDE 扩展的 Next Edit 以及 Completions 功能 程序员 • beginor • Feb 28 • Lastly replied by tlerbao | 6 |

| 大家的流量卡都是在哪里买的? 问与答 • beginor • 4 days ago • Lastly replied by Serrortop | 74 |

| Jetbrains 的家的 Fleet 果然烂尾了! JetBrains • beginor • Dec 12, 2025 • Lastly replied by securityCoding | 79 |

| 将红米 K40S 解锁刷了 Lineage 22 小米 • beginor • Nov 28, 2025 • Lastly replied by beginor | 11 |

| Jetbrains 家的 IDE 智能提示终于有好用的了,那就是 Qoder ! JetBrains • beginor • Nov 27, 2025 • Lastly replied by bitmin | 40 |

| 求一份在 macOS 上能用的 sing-box 1.12 的 tun 配置 问与答 • beginor • Feb 5 • Lastly replied by beginor | 20 |

| Augment 已经没有免费帐户了 程序员 • beginor • Sep 18, 2025 • Lastly replied by dianso | 2 |

| Augment 貌似被墙! 程序员 • beginor • Jun 27, 2025 • Lastly replied by asuraa | 9 |

| 英菲克 IN 10 鼠标在 MacBook Pro 上体验怎么样? 硬件 • beginor • Jun 6, 2025 • Lastly replied by shoaly | 2 |

beginor's recent replies

6 days ago Replied to a topic by skygod › OpenAI › 都在用哪些 ai 网关 |

newapi 算不算?

9 days ago Replied to a topic by Sezxy › MacBook Pro › 到手了个 macbook pro,但好像没啥用 |

佬,抽了吧😜

14 days ago Replied to a topic by Hermitist › Local LLM › 推荐一个 GPU 推理速度计算器, 可能方便买配件自建本地大模型的人用上 |

算法不太准确,比实际的高很多,M1Max 用户路过

15 days ago Replied to a topic by manami › macOS › Mac 新手 SSH 客户端推荐 |

vscode + remote ssh 最好用,连接到 ssh 服务器 之后,在 VSCode 的 Explorer 面板就可以上传下载了

Apr 28 Replied to a topic by zisen › Windows › 求 Windows UWP 软件大佬实现一个 terminal 功能 |

warp 更好前几天更新了垂直标签的功能,可以试下

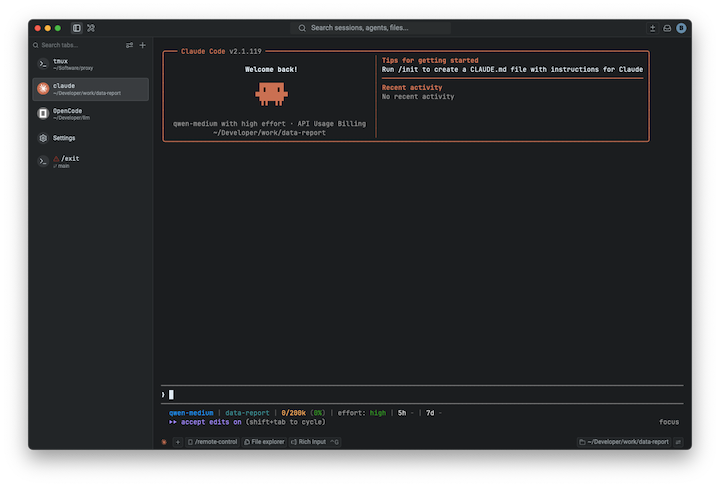

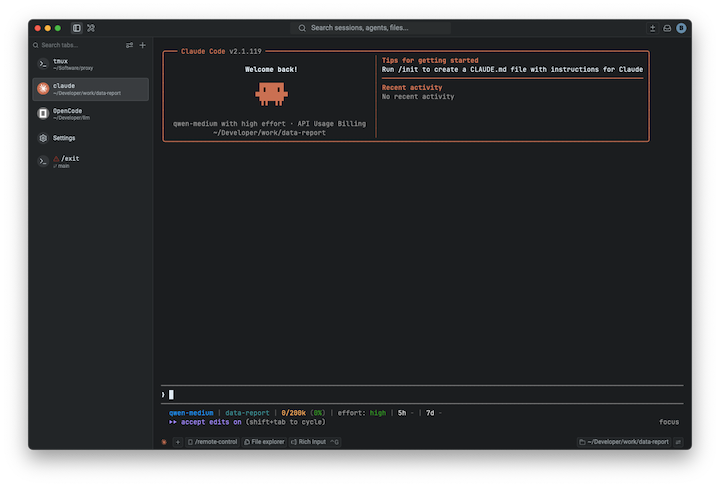

[]( https://postimg.cc/QHFdmV25)

[]( https://postimg.cc/QHFdmV25)

Apr 27 Replied to a topic by fightingCode948 › 程序员 › 买 mac 还是转 Linux 系统 |

1. SSD 换成 1T 的,至少 512G ;

2. 拆掉机械盘,如果可以的话也换成 SSD ;

2. 拆掉机械盘,如果可以的话也换成 SSD ;

Apr 25 Replied to a topic by KaiWuBOSS › Local LLM › 我做了个工具让 8GB 显卡跑 30B 模型从 3 tok/s 提到 21 tok/s,记录一下技术发现 |

新版本的 llama.cpp 支持 --cpu-moe 参数, 即将所有的 MoE 权重放在 CPU ,是这个意思么?

https://github.com/ggml-org/llama.cpp/blob/master/tools/server/README.md

https://github.com/ggml-org/llama.cpp/blob/master/tools/server/README.md

Apr 8 Replied to a topic by ahdw › Local LLM › 闲置 16GB M1 Pro MBP 跑大模型 |

不要那么悲观,本地跑一个 Zeta 或者 Qwen coder 配合 llama-code 插件做代码提示还是挺好的 🙂

Mar 31 Replied to a topic by MoGeJiEr › Claude › claude code 源码泄露 |